2023年8月23日から25日にかけての3日間で行われた、ゲームに関する技術や知識を共有する国内最大規模のカンファレンス“CEDEC2023”。

本稿では、最終日に行われたセッション“FINAL FANTASY XVI:おうちDEモーションキャプチャ”の内容をまとめてお届けする。

本セッションでは、『ファイナルファンタジーXVI』(『FF16』)チームがリモートワークへ移行する際に行われた、自宅でモーションキャプチャを撮影できる環境作りの取り組みが紹介された。実際に使用した機材の所感や、手軽にモーションキャプチャ撮影を行えるようにするメリットなどについて言及されているので、モーション制作などに興味がある人は要チェックだ。

登壇したのは、スクウェア・エニックスのアニメーターである佐藤逸人氏と、テクニカルアーティストの髙田英治氏。共同研究・開発者として同社の敷島明紀生氏、坂本琢磨氏の名前も挙げられた。なお、今回のセッションで使用された『FF16』の画像は開発段階のものであり、製品版とは異なる部分がある。

リモートワーク×モーションキャプチャ=おうちDEモーションキャプチャ

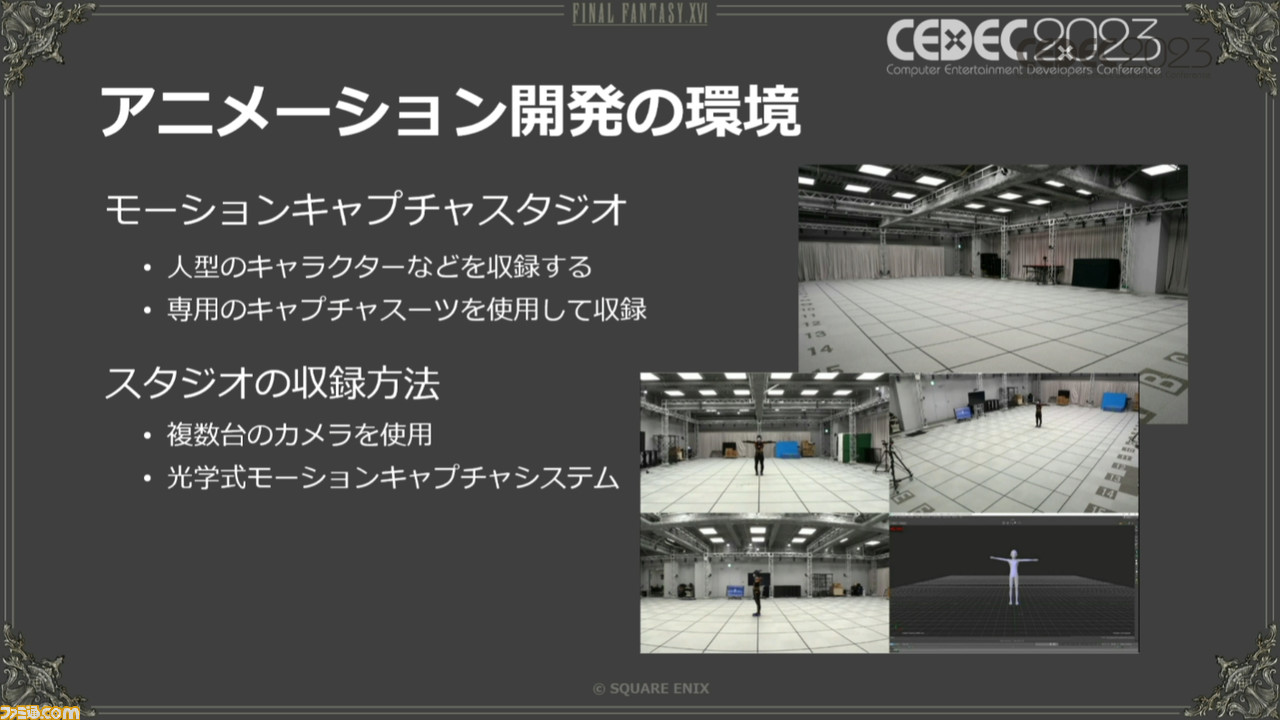

セッション冒頭では『FF16』がアクションRPGであるという簡単な前置きをしたうえで、本作におけるアニメーション開発の環境が紹介された。スクウェア・エニックスでは2020年からリモートワークが始まっていたが、モーションキャプチャの撮影や収録は依然スタジオで行われていたという。

リモートワークとモーションキャプチャスタジオでの収録を両立させる方法はないか、と模索するなかで考案されたのが、セッションのタイトルにもなっている“おうちDEモーションキャプチャ”だ。

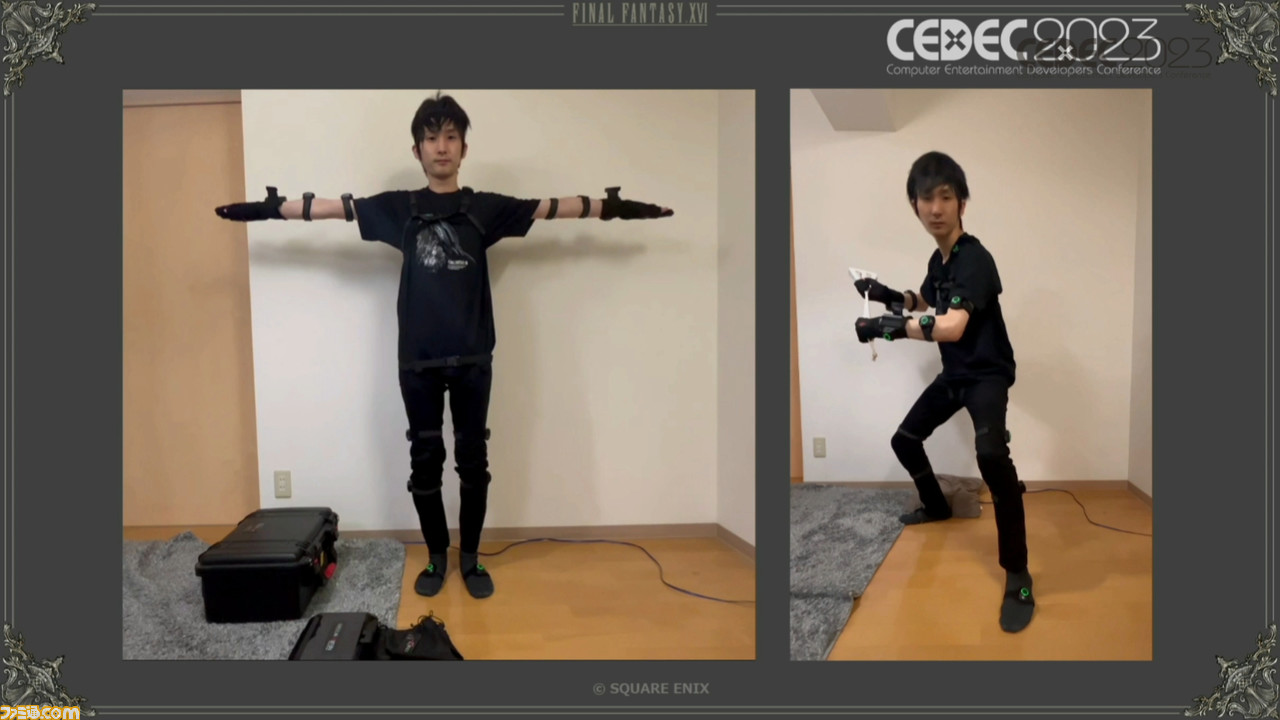

つぎに披露された動画は、佐藤氏が自身の専用スタジオと化した自宅の一室でモーションキャプチャを行う様子だ。小型の加速度センサーなどを使い、ときには手にふとん叩きを持って武器を背中に収める納刀モーションのキャプチャを行ったという。

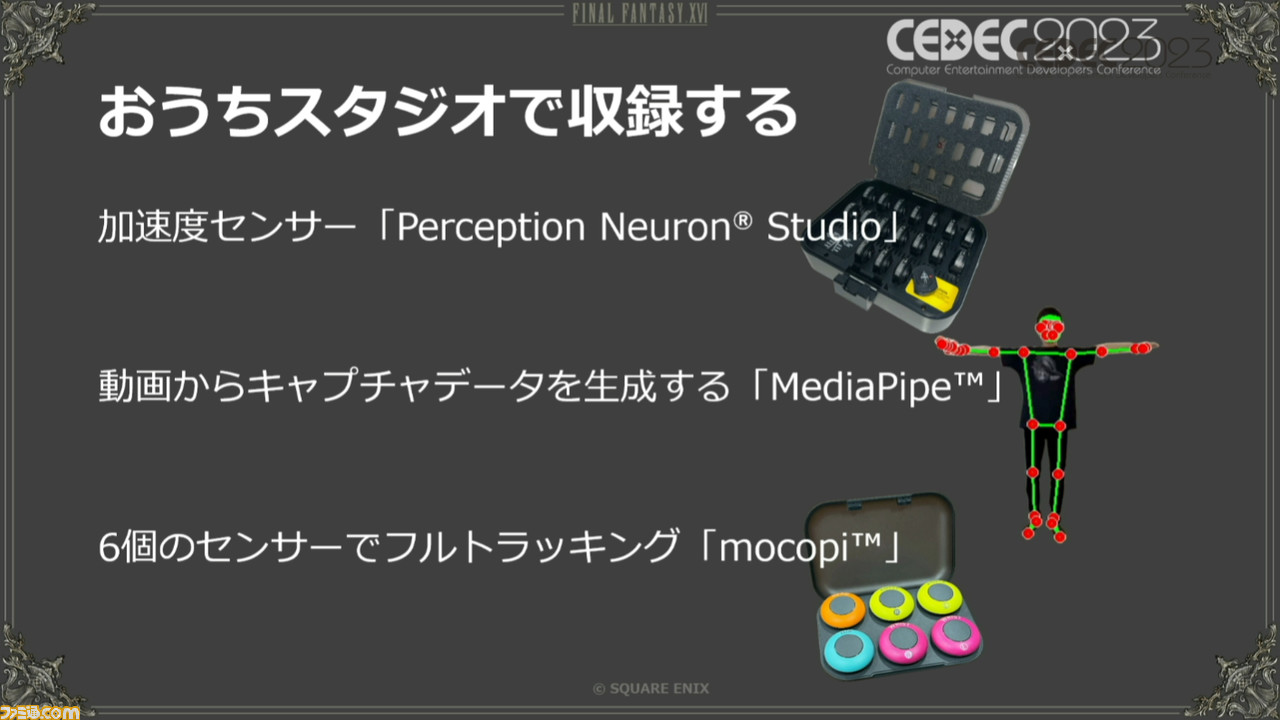

この“おうちスタジオ”での収録で使用されたのは、加速度センサーのPerception Neuron Studio、動画からキャプチャデータを生成するオープンソースソリューションのMediaPipe、そして今年の1月に発売され注目を集めたフルトラッキングセンサーのmocopi。なお、mocopiについては発売したのが開発もほぼ終了した段階だったこともあり、今回はあくまで検証結果の紹介となっている。

6分強で装着可能なお手軽加速度センサー

まずは加速度センサーのPerception Neuron Studioについて、テクニカルアーティストの髙田氏より解説が行われた。こちらを採用した理由としては、コンパクトかつキャプチャ精度が高かったことが挙げられた。

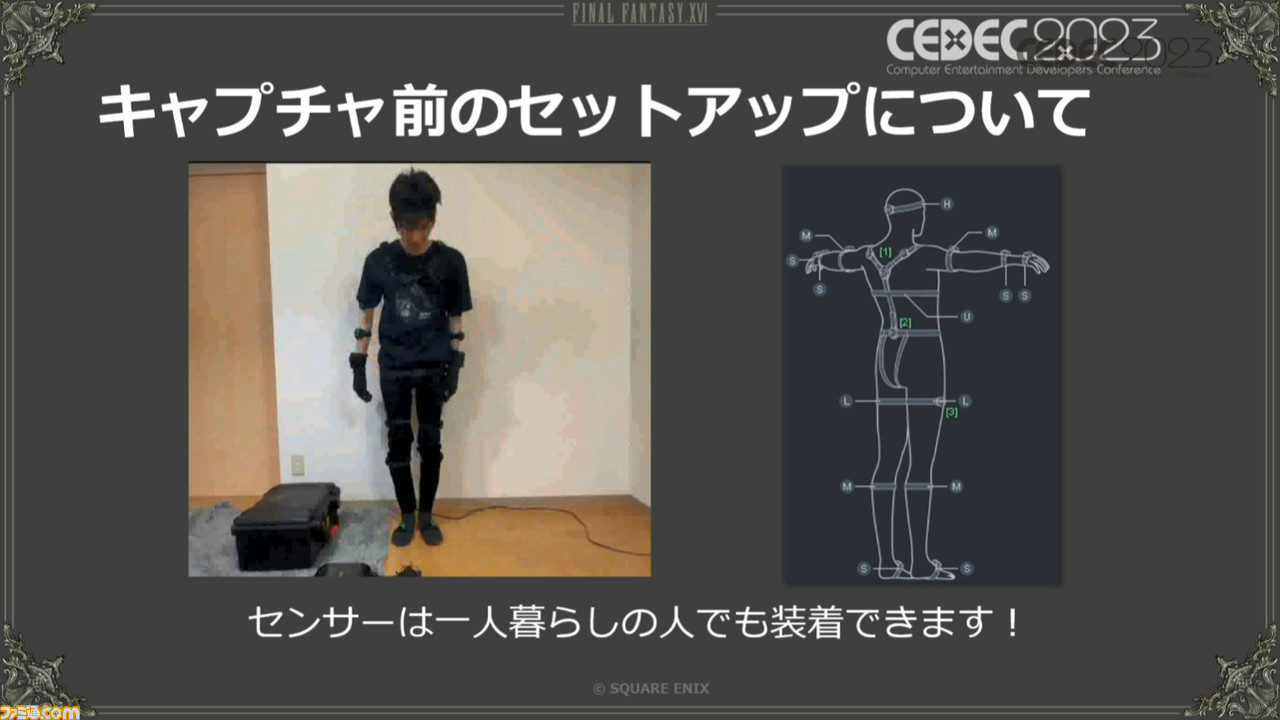

加えて、ひとりでも撮影のセットアップが可能な装着の容易さもポイントだったという。センサーはマジックテープのベルトで留められ、充電式かつ無線なので動きのジャマにもならず、撮影中に装着位置がズレてしまうこともなかったそうだ。

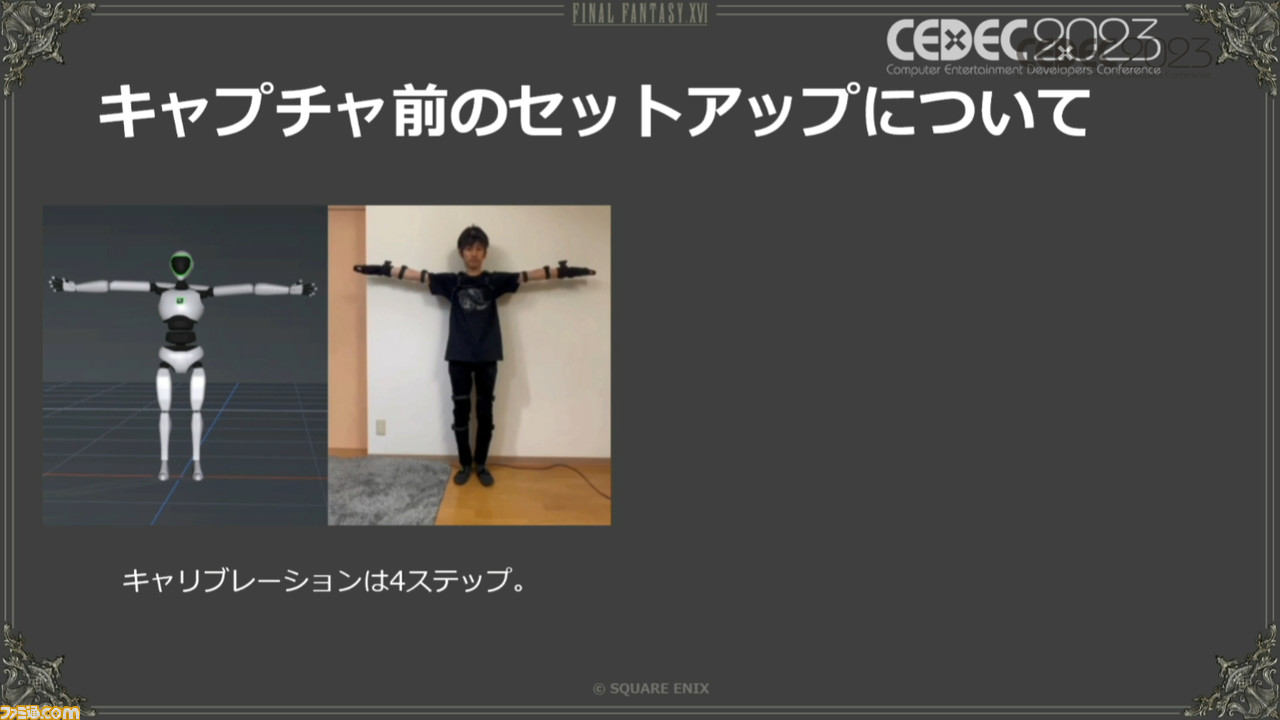

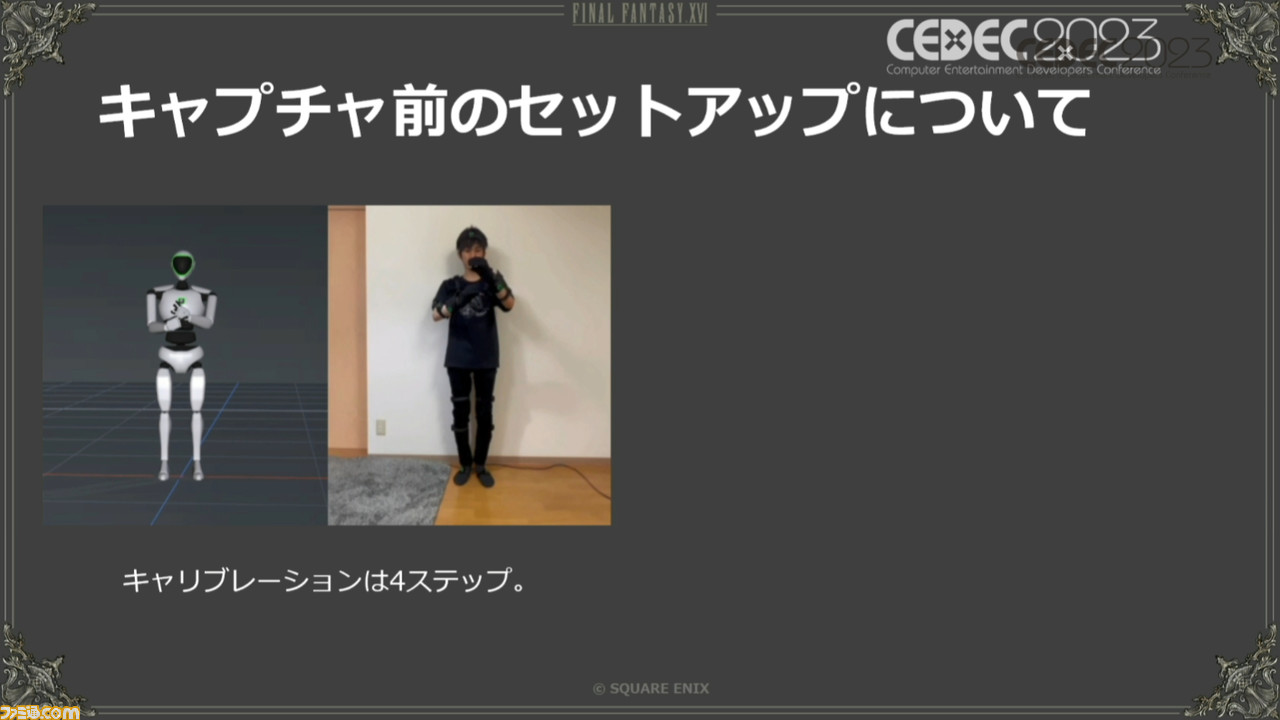

撮影前のセットアップ工程として、センサーどうしの位置や角度といった情報を定義するキャリブレーションも必要だ。Perception Neuron Studioでは直立、Tポーズ、両手を合わせるポーズ、身体の前でものをつまむようなポーズ、この4つのポーズを取るだけでキャリブレーションが完了するという。

キャリブレーション以外にも細かなセットアップはあるが、それらについてはセンサーと連携するAxis Studioというソフトが案内を行ってくれるため、ひとりでも迷うことはないとのことだ。

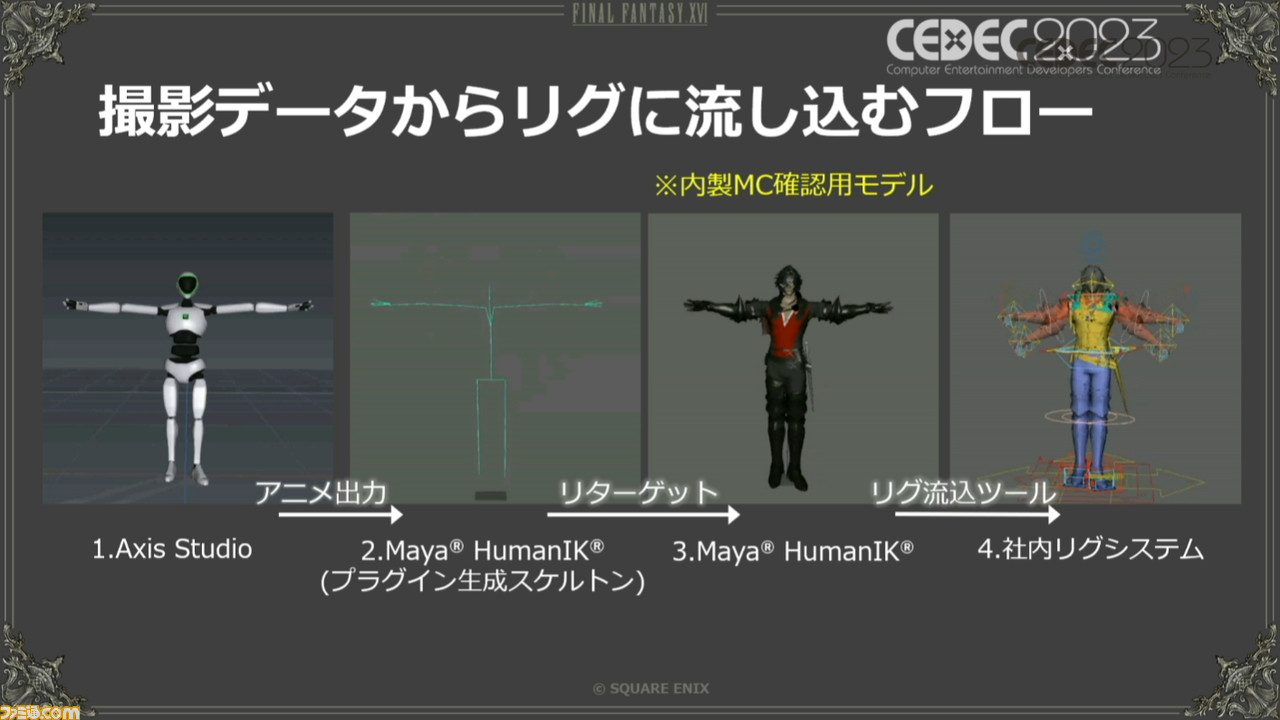

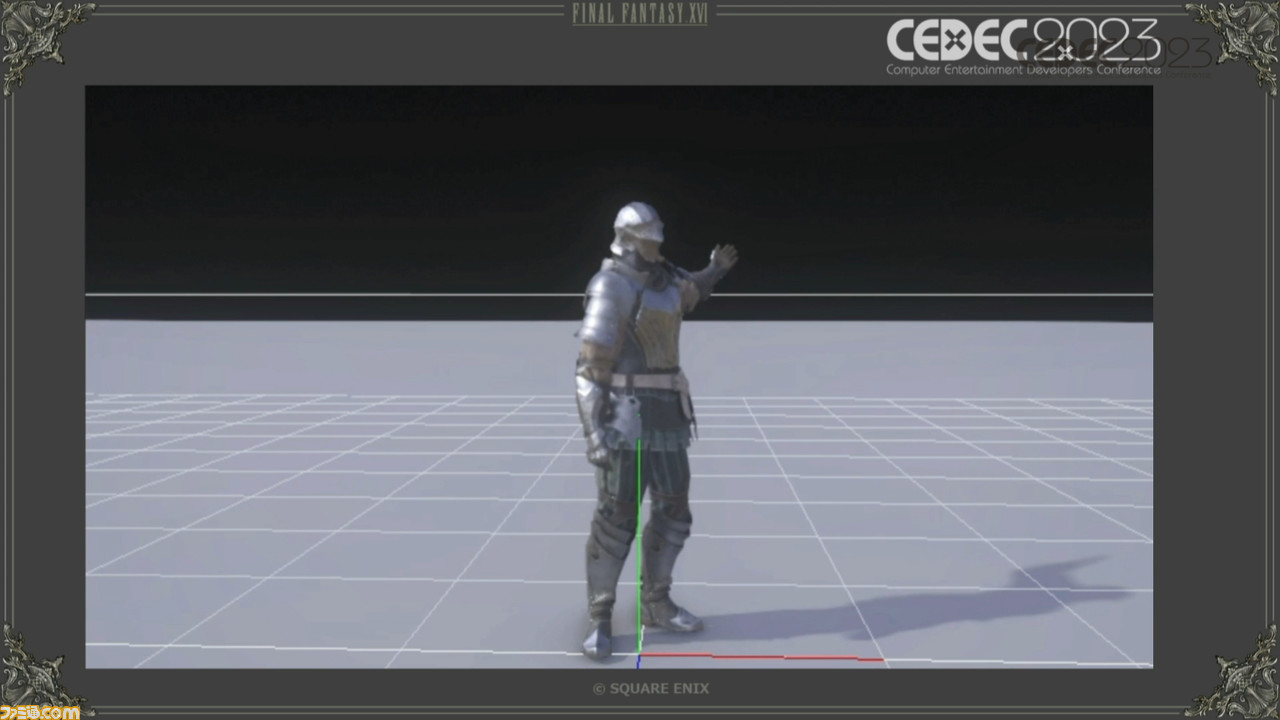

撮影後は、Axis Studioが受信したキャプチャ情報からデータが出力されるので、そこからPerception Neuron Studioの提供するMaya用プラグインでHumanIK(アニメーションデータ)を作成する。そのアニメーションをもともとスタジオ収録期間に使用していたHumanIKに移し、そこから内製ツールを使ってリグに流し込む、という流れでアニメーションが制作されたという。

なお、Perception Neuron StudioはMaya上でリアルタイムにキャプチャを行うことも可能だが、撮影してから流し込むほうがキャプチャ結果の編集などができるため作業を進めやすく、『FF16』のアニメーション制作ではリアルタイムキャプチャは使用されなかったとのことだ。

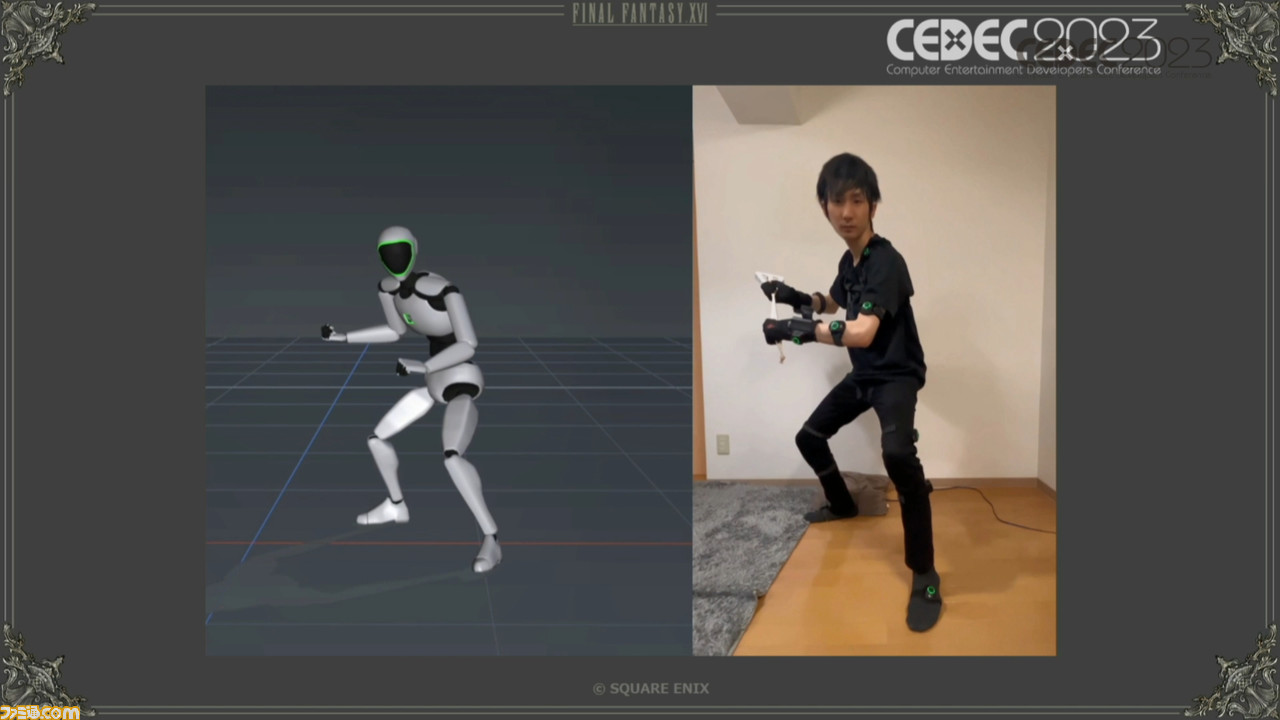

実際に収録を行っている様子を写した動画も披露されたが、キャプチャ元となる動画のニュアンスをしっかりと汲み取ったモーションになっていることが確認できた。

また、このキャプチャはビデオ通話をしながら収録することができたのも便利だったという。ミーティング後すぐにデータを共有でき、撮り直しも容易だったため安心して作業を進めることができたそうだ。

さらに、Perception Neuron Studioは手だけなど部分ごとの撮影も可能。今回の検証は全身撮影のみだったとのことだが、カットシーンで手のアップ、手の演技だけを見せたい場合などにはこの機能が役立ちそうだ。

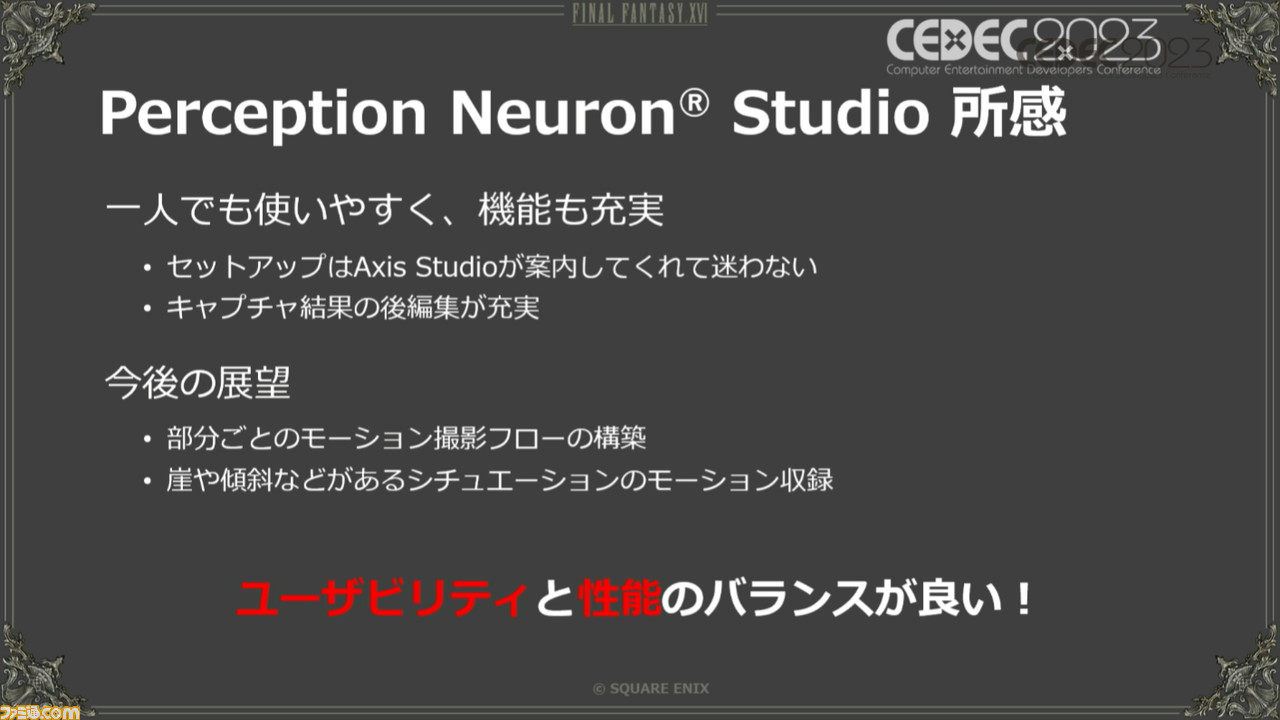

結論として、Perception Neuron Studioはひとりでも容易に装着やセットアップができ、かつキャプチャ結果の後編集についても充実しているなど、手軽さと機能性を兼ね備えたものだった。

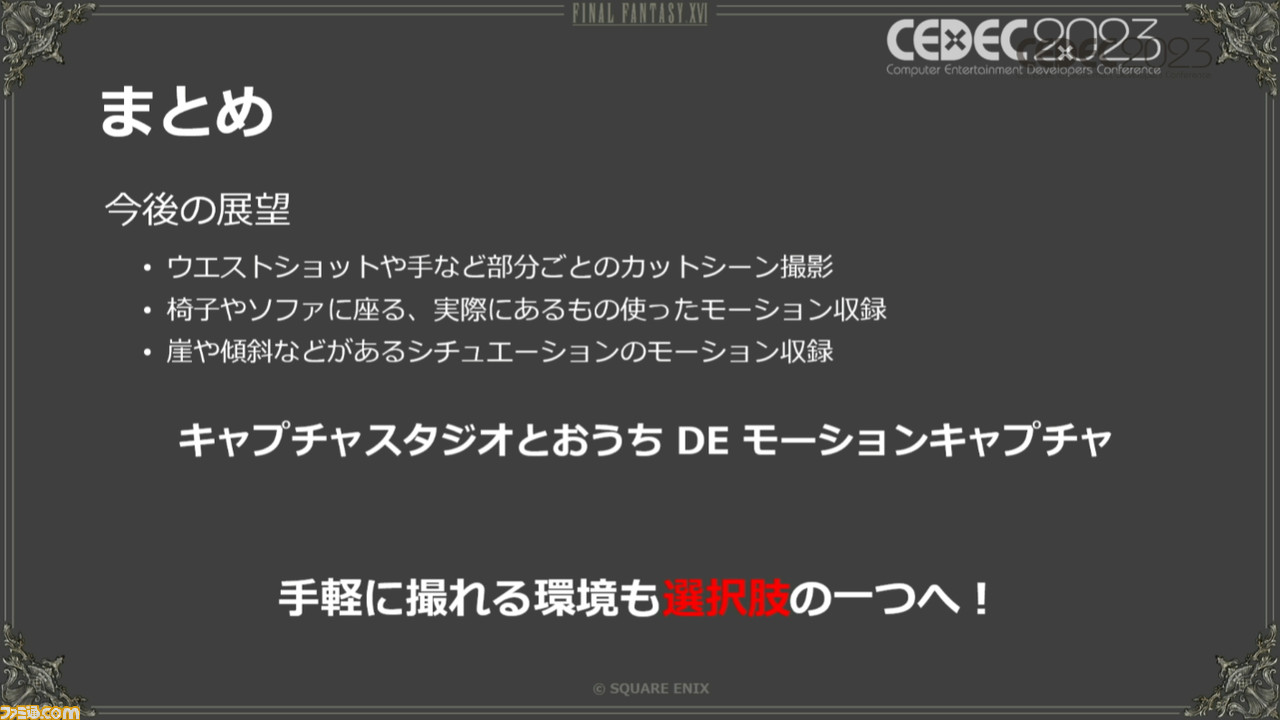

今後は手だけ・足だけなど部位ごとのモーション撮影フローの構築や、家のなかにある階段などを使って傾斜を上り下りするようなモーションの収録にもトライしたいとのことだ。

カメラ1台でモーションキャプチャ

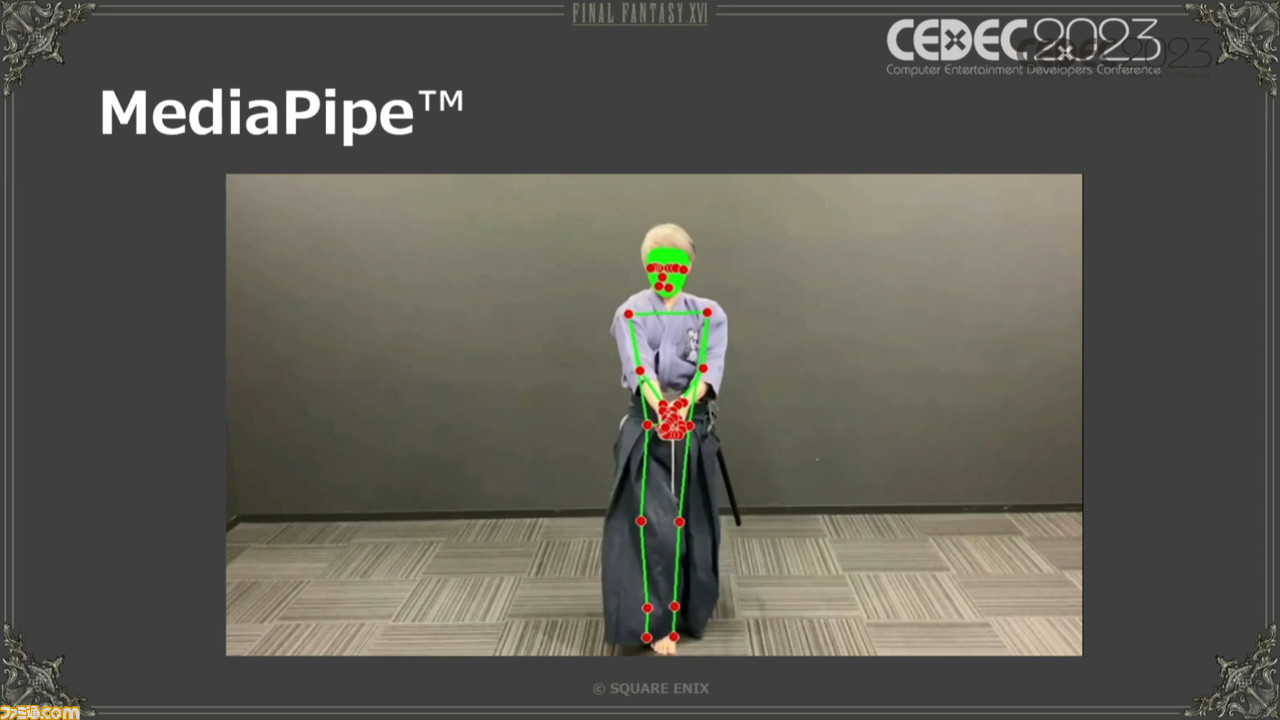

続いては、グーグルが提供する機械学習のオープンソースソリューション・MediaPipeを使ったモーションキャプチャの紹介だ。

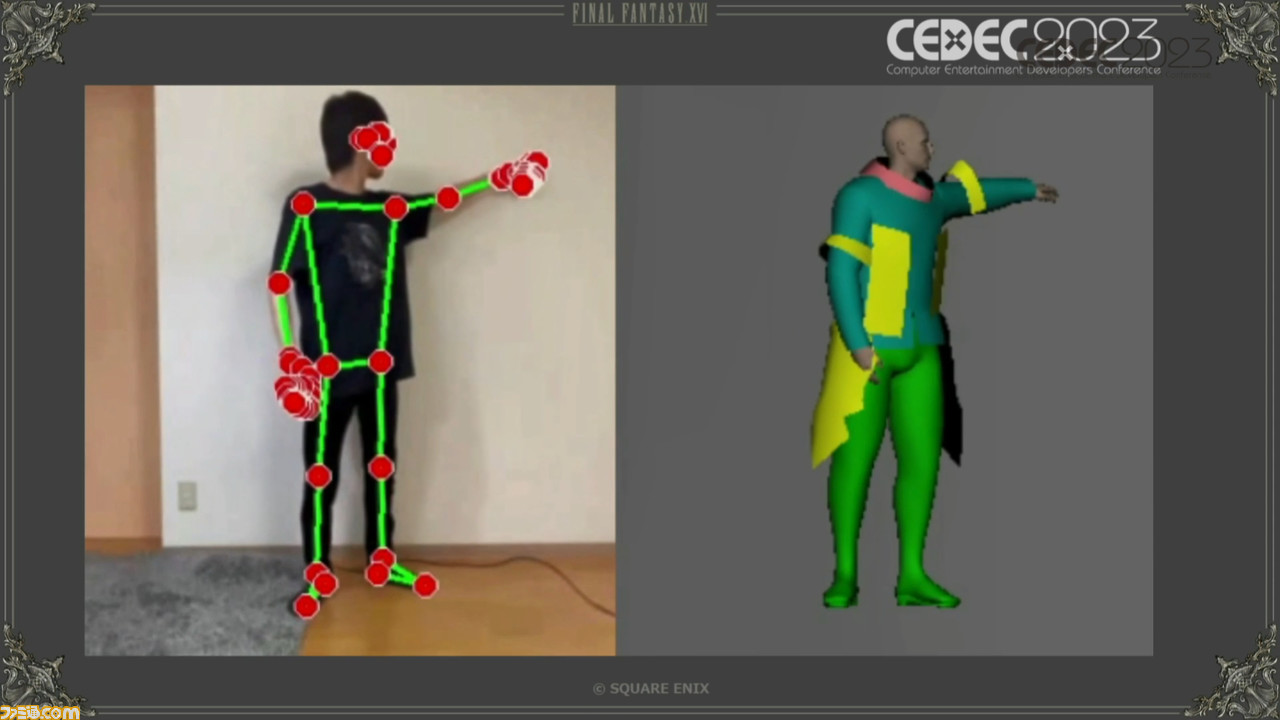

まずは『FF16』の主人公クライヴが肩で息をするモーションが出され、これがカメラ1台で撮影した動画から作られたものだと明かされた。カメラ1台あればモーションをキャプチャできる、というのは驚異的なまでに手軽だ。

ほかにも、テクニカルアーティスト班の趣味で居合をやっているメンバーのモーションを撮影した映像も披露された。足運びを隠す袴のせいで下半身の追跡はややおぼつかないものの、上半身の動きはしっかり捉えていた。

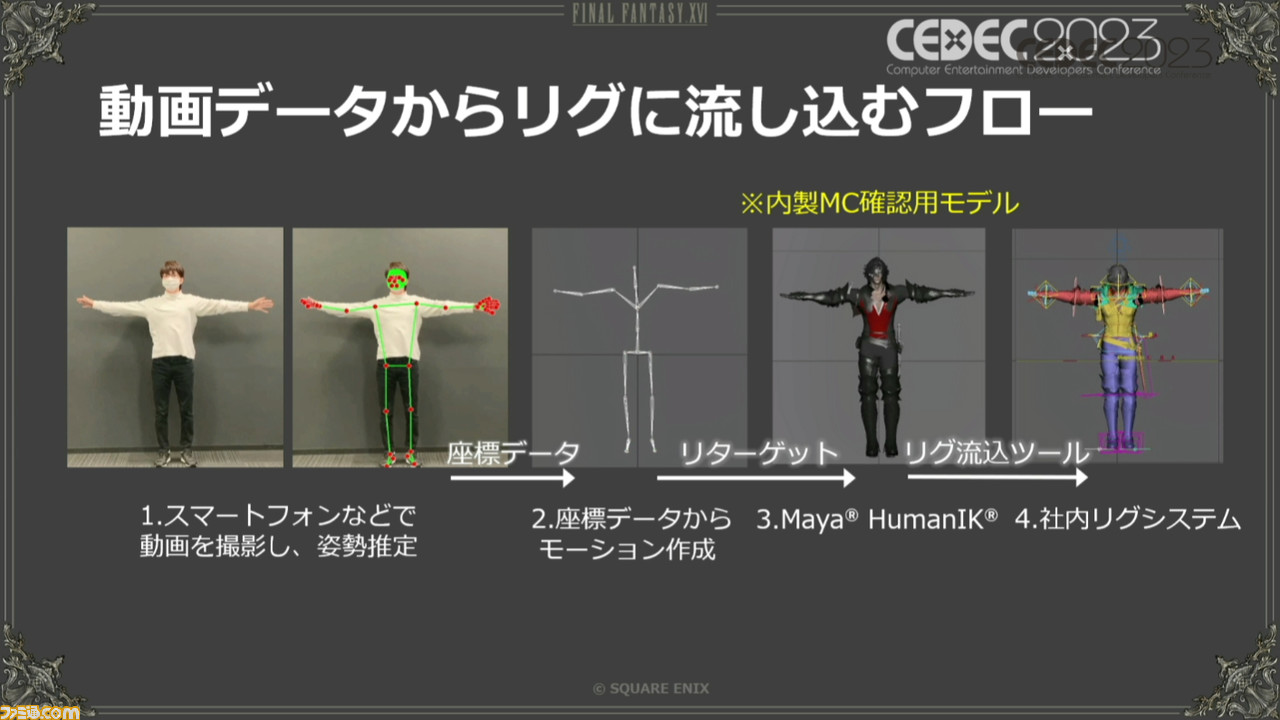

MediaPipeで撮影した動画からリグに流し込むフローとしては、スマートフォンなどで動画を撮影し、推定した姿勢の座標を出力する。

その座標からフレームごとの位置を取り出しこれをスケルトンの回転に変換。その回転情報をHumanIKのリグに移し、これをプロジェクトで使用しているHumanIKに移し替え、そのデータをリグに流し込む……といった流れだ。

MediaPipeはキャプチャスーツやマーカーの準備が必要ないため、アイデアを思い付いた瞬間に撮影できるのが強みだ。

今後の展望としては、カットシーンの完成イメージを伝えるための仮モーションの作成や、その場で演技をするモーションも作っていけるだろうとのこと。また、カメラを増やすことでさらに拡張できる可能性もあるという。

1分装着&スマホでキャプチャ

セッションの最後に紹介されたのがmocopiを使ったモーションキャプチャの検証結果だ。

mocopiはソニーが2023年1月に発売した小型のセンサーで、専用のスマホアプリを使って動きを計測することができる。6つのセンサーをベルトに着けるだけでいいので、佐藤氏が収録した動画でも装着にかかった時間はわずか1分13秒とかなり手軽に準備ができていた。

スマートフォンで収録できるという性質を生かし、佐藤氏はスマートフォンを片手に歩き回りながらの収録を行った。

キャプチャした映像ではうろうろと歩き回り、扉を開けたり靴を脱いだりといった日常的な動きについても自然に再現されていた。この結果を見て、佐藤氏は今後広い用途での活躍が期待できるのではと語っている。

「実際に使ってみて、mocopiは家での収録には十分な性能を持っており、装着時にも気にならないコンパクト感やスマートフォンでつねに収録している状態を確認できるのも大きな利点だと感じた」というのが佐藤氏の感想だ。

今後は足運びのある移動系のアニメーション、空間を生かした演出の再現などにも役立つだろうとのことだ。

まとめ

本セッションのまとめとして、今回紹介したツールを使うことでビデオ通話をしながらキャプチャが行える、カメラ1台あればキャプチャできる、などの新しい発見があったと佐藤氏は語った。

手軽に収録が行えるぶん開発中にアニメーションのイメージが変わったとしても修正も行いやすくなりそうとのことだ。

現在は検証段階にあるものの、今後クオリティが伸びていくであろうことも含め、期待が高まるキャプチャ素材だという。今後もスタジオでの収録は行っていくが、それと同時に自宅でできるキャプチャ方法を模索していきたい、という言葉で発表は締めくくられた。

mocopiについては登場時にいわゆるVTuber界隈でも話題になったが、今回紹介された“おうちDEモーションキャプチャ”の技術はゲーム開発以外の分野、あるいは個々人の活動などでも活躍しそうだ。

モーションキャプチャと言えば全身に黄色い球体の付いたスーツを着込んで……というイメージの時代から考えると恐ろしいまでの進化。昔と比べて個人でモーションキャプチャを利用する人も増えたぶん、使用機器についてもより手軽なものが発展していきそうだ。

『ファイナルファンタジーXVI』(PS5)の購入はこちら (Amazon.co.jp)